Thema's

Artificial Intelligence

Wat als AI eigen beslissingen gaat nemen?

Big Data

Waar stopt de groei van data, is het nog te controleren?

Cloud

Innoveren & inspireren het begint in de Cloud.

Compliance & Governance

Blijf op de hoogte NIS2, Dora en meer

Cyber Security

Hoe voorkom je dat je aan de beurt komt?

Data Management

Data Management draait om het efficiënt verzamelen, beheren en benutten van gegevens.

Datacenters

Ontdek het datacenter van de toekomst!

Digital Workspace

De moderne werkplek in een nieuw jasje.

Duurzame IT

De IT wereld van vandaag is anders dan die van morgen.

Fixed Wireless Access

Fixed Wireless Access levert snel internet via een draadloze verbinding

IoT

Hoe snel verandert de wereld om ons heen?

Networking

Het netwerk van nu, zal anders dan dat van morgen

Unified Communications

Ook UC ontkomt niet meer aan de Cloud, wat moet je weten?

Cloud Expo Beursmagazine

Cloud Expo 2025 laat zien dat de digitale transformatie niet wacht. Met 225 exposanten, 165 kennissessies en duizenden bezoekers wordt zichtbaar hoe snel onze sector beweegt: AI verandert van hulpmiddel naar collega, security wordt autonomer, data keert terug naar Europa en de cloud krijgt een nieuwe vorm.

Deze beweging voel je straks overal op de beursvloer, maar je kunt er nu al een voorproef van krijgen. In het Cloud Expo Magazine lees je de visies en verhalen die laten zien wat er op ons afkomt en waarom de keuzes van vandaag bepalend zijn voor de komende tien jaar.

Vind jouw perfecte match tijdens Cloud Expo

Tijdens Cloud Expo 2025 nodigen we je uit aan de Ctac Group Bar, de plek waar technologie en ontmoetingen samenkomen. Onder het genot van een drankje, geserveerd door barman Victor (bekend van het tv programma First Dates), maak je kennis met de mensen achter Ctac Group. Wie weet vind jij hier niet alleen inspiratie, maar ook jouw perfecte IT match.

Naast de gezellige sfeer biedt Ctac een inhoudelijk programma waarin kunstmatige intelligentie centraal staat. Laat je inspireren door AI Champion Eline Schoonen en Executive Principle Vincent Mejan, die laten zien hoe AI organisaties helpt om slimmer te werken, processen te versnellen en beter samen te werken.

Meld je aan voor de "perfecte match"!

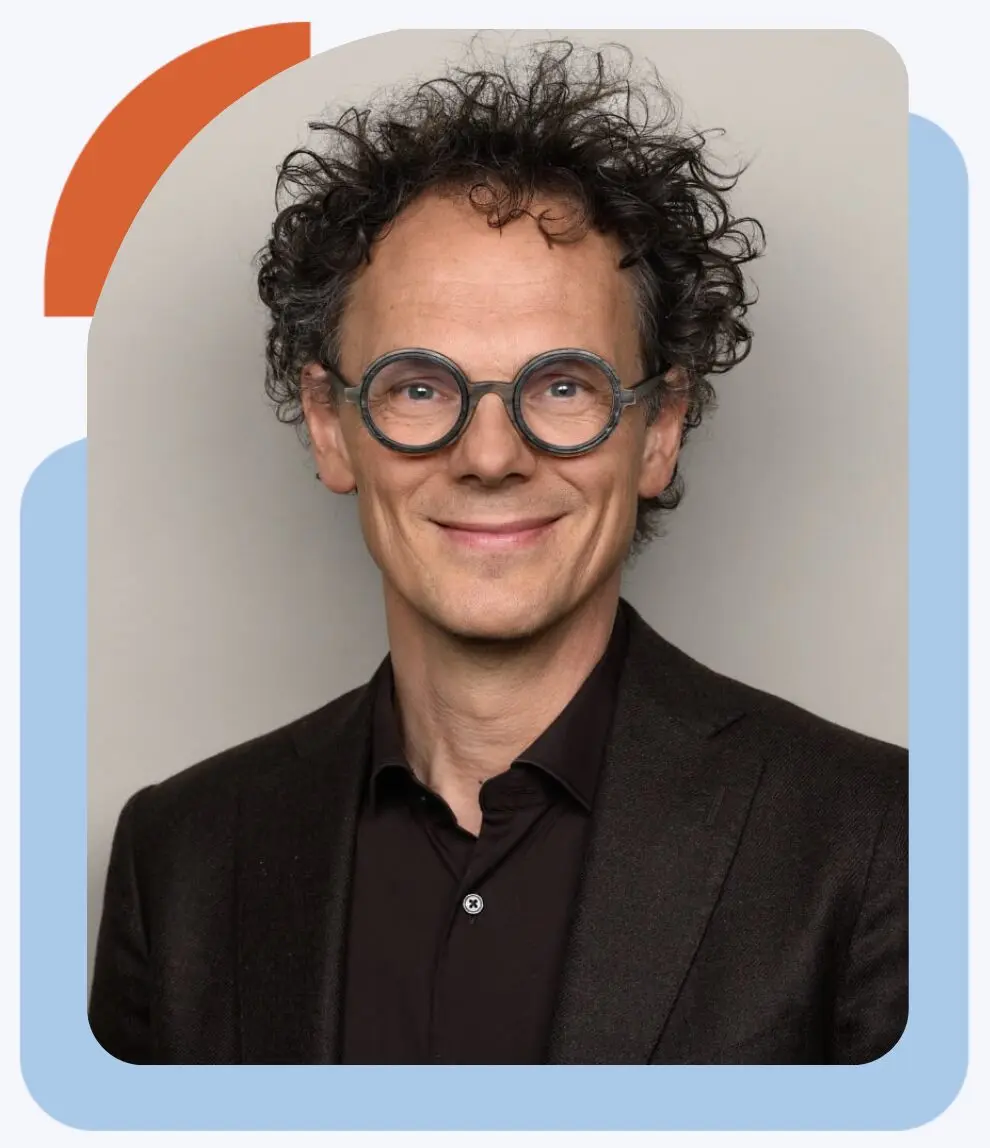

Raymond Mens: de Amerikaanse invloed en impact op onze digitale wereld

Tijdens Cloud Expo 2025 verwelkomen we een bijzondere spreker in het theaterprogramma: Raymond Mens, Amerikadeskundige en vaste gast bij Vandaag Inside. Raymond staat bekend om zijn scherpe analyses en toegankelijke manier van vertellen over de invloed van de Verenigde Staten op Europa.

In zijn sessie kijkt hij naar de manier waarop Amerikaanse politiek, wetgeving en technologische keuzes – van AI tot cyberstrategie – onze digitale toekomst vormgeven. Waarom volgen we vaak de koers die in Washington wordt uitgezet? En wat betekent dat voor Nederland, dat juist inzet op digitale soevereiniteit en eigen innovatiekracht?

Met zijn kennis van geopolitiek, media en maatschappij belooft Raymond een sessie die perfect past bij het thema van Cloud Expo: Changing Innovation. Een inspirerend half uur waarin internationale politiek en technologie samenkomen – met directe relevantie voor iedereen die werkt in de wereld van IT, cloud en security.

Zijn sessies vinden plaats op donderdag 4 december, om 15:00 uur en 15:45 uur in Theater 1

Ben van den Burg op Mainstage

Tijdens Cloud Expo 2025 verwelkomen we een bijzondere gast op het Mainstage: Ben van der Burg, bekend van Vandaag Inside, voormalig topschaatser, ondernemer en technologiecolumnist. Ben neemt bezoekers mee in zijn actuele, soms confronterende maar altijd inspirerende visie op technologie, digitalisering en menselijk gedrag. Zijn keynote vindt plaats op woensdag 3 december van 12:30 tot 13:30 uur, precies tijdens de lunchpauze, zodat iedereen de kans krijgt om aan te schuiven.

Met zijn unieke mix van energie, humor en scherpe observaties belooft Ben een lezing te geven die past bij de mentaliteit van Cloud Expo: vooruitkijken, vernieuwen en jezelf durven uitdagen. Daarmee treedt hij in de voetsporen van eerdere Mainstage-sprekers zoals Bas Nijhuis, Robert Doornbos en Jack Plooij, die de afgelopen jaren het podium kleurden met hun verhalen over leiderschap, tegenslag en succes.

Cloud Expo: Changing Innovation!

De cloud is allang niet meer alleen een IT-oplossing. Het is een katalysator voor verandering. Maar wat betekent deze veranderende innovatie concreet voor jouw organisatie?

Tijdens Cloud Expo ontdek je hoe de cloud businessmodellen, processen en zelfs complete markten opnieuw vormgeeft. Niet alleen de voordelen, maar ook de uitdagingen: kosten, beveiliging, autonomie én afhankelijkheid. Je krijgt helder inzicht in wat deze verschuiving betekent voor jouw strategie, je team en je toekomst.

In de Cloud Theaters delen vernieuwers zoals Microsoft, Nvidia en Dell hoe zij innovatie blijven veranderen van AI tot hybride infra en van cybersecurity tot edge computing. Geen theorie, maar toepasbare inzichten die je morgen kunt gebruiken.

Laat je inspireren door de technologieën die vandaag al de toekomst vormgeven. Ervaar hoe Changing Innovation niet stopt, maar steeds opnieuw begint op 3 & 4 december 2025 tijdens Cloud Expo in Houten.

Cloud Expo Recap 2024

In 2024 vond de derde editie van Cloud Expo plaats, en groeide aanzienlijk vergeleken met het voorgaande jaar. Met ruim 200 exposanten en maar liefst 6.800 bezoekers was de beurs een belangrijk platform voor technologiebedrijven en IT-professionals om de nieuwste trends te ontdekken en netwerken op te bouwen.

Een van de opvallende ontwikkelingen dit jaar was de introductie van AI op de beursvloer. Verschillende exposanten lieten zien hoe kunstmatige intelligentie wordt ingezet om bedrijven te helpen bij de transitie naar de cloud, het beheer van grote hoeveelheden data, en het voorkomen en herstellen van cyberaanvallen, zoals ransomware.

Bekijk de sfeerbeelden van de Cloud Expo en de Beachparty hier.